Was ist Resonanz-System-Design?

Resonanz-System-Design ist ein interdisziplinäres Forschungsfeld, das sich auf die Gestaltung von Schnittstellen, Interaktionen und Systemen konzentriert, die Menschen und künstliche Intelligenz in synergetischer Weise zusammenbringen. Es zielt darauf ab, die Stärken beider Seiten zu nutzen, um kreative, produktive und ethisch fundierte Lösungen für komplexe Probleme zu entwickeln (Shneiderman, B. (2020). Dabei werden Aspekte der Kognitionswissenschaft, des UX-Designs, der Ethik und der KI-Forschung integriert.

Als Hauptpunkte des Resonanz-System-Design-Thinking werden vorerst folgende Punkte vorgeschlagen:

• Fokus auf Menschen

• Kollektive Visionen sichtbar machen

• Service-Prototyping

• Kreative Ideengenerierung

• Entwicklung effektiver Lösungen und Perspektiven

Einleitung

Ausgangspunkt dieses Konzepts ist die Beobachtung, dass komplexe dynamische Systeme wie eine Demokratie kaum durch einzelne politische Strömungen für alle Akteure und Randgruppen zufriedenstellend gelöst werden können. Vor allem aus kognitiver Sicht erscheint es mehr als abwegig, dass eine einzelne politische Führungspersönlichkeit in der Lage ist, sich um „alle“ Bürger zu kümmern, auch wenn sie dies in Wahlreden immer wieder beteuert.

Die Herausforderung besteht also darin, dass komplexe dynamische Systeme parallele Lösungen erfordern, die an die Realität der verschiedenen Gemeinschaften (Resonanzräume) angepasst sind. Die vielleicht noch größere Herausforderung besteht also darin, die Systemabläufe und Informationskanäle so zu gestalten, dass sie der Art der angestrebten kollektiven Entwicklung und den Möglichkeiten eines Resonanzraumes entsprechen. D.h. vor allem, welche gemeinsamen und individuellen Perspektiven, Leitbilder, Visionen in einem Resonanzraum hervorgerufen und angeboten werden.

Daher wird hier das in der Psychologie und anderen Disziplinen entwickelte Konzept der sozialen Entropie aufgegriffen, um ein Maß zu entwickeln, das die soziale Ruhe oder Unruhe einer Bevölkerung misst und Hinweise darauf gibt, ob politische oder andere makrosoziologische Aktivitäten die Entwicklung der Gesellschaft fördern.

Wenn also der 47. Präsident der Vereinigten Staaten von Amerika unmittelbar nach seinem Amtsantritt Anfang 2025 die rund 1.600 Personen, die 2021 das Kapitol in Washington zum Teil gewaltsam gestürmt haben, begnadigt und von jeder Verantwortung freispricht, so kann dies als Hinweis darauf gelesen werden, dass die soziale Ordnung nicht beruhigt, sondern die soziale Entropie erhöht werden soll.

Dies steht im Einklang mit seinem größten finanziellen Unterstützer, der mit allen Mitteln eine Vorstellung von Meinungsfreiheit durchsetzen will, die darin besteht, jede moderierte Intervention in den sozialen Kanälen auf ein Minimum zu reduzieren. Dies führt jedoch nicht dazu, dass die Nutzer dieser sozialen Kanäle besser informiert werden, sondern dass sie mit zu vielen Informationen überflutet werden, was wiederum die soziale Entropie erhöht.

In komplexen dynamischen Systemen, wie dem Menschen als Individuum, sowie in Gruppen, Gemeinschaften bis hin zu einer globalen Zivilisation, ist eine sinnstiftende und verständliche Modellierung des Systems wichtig, um sich darin mit einem Gefühl der Verbundenheit (Sicherheit) und verschiedenen (individuellen) Entfaltungsmöglichkeiten darin bewegen zu können. Dieses Gefühl ist jedoch immer verkörpert (embodied), eingebettet (embedded), erweitert (extended) und interaktiv (enactive).

Diese kognitive Logik bringt bereits zum Ausdruck, dass herkömmliche Modellierungen keine befriedigende Erklärung liefern können, da jeder Mensch und jede Gemeinschaft sehr spezifische Anforderungen und Bedürfnisse hat. Daher führt jede Vereinfachung in der Regel zu einer abstrakten Unzulänglichkeit, die nicht in der Lage ist, eine umfassende Realität abzubilden.

Daher wird hier versucht, komplexe dynamische Systeme vor allem über die Phänomene Entropie, Synchronisation und Emergenz zu betrachten und zu diskutieren. Auch wenn ein direkter Zusammenhang zwischen diesen Phänomenen naturwissenschaftlich noch nicht exakt erfasst werden kann, zeigt z.B. die Belousov-Zhabotinsky-Reaktion, dass stabile emergente Muster auch dann entstehen können, wenn die Gesamtentropie im System zunimmt.

Die Entwicklung künstlich intelligenter Systeme stellt eine Möglichkeit dar, diese komplexen Phänomene für die Weiterentwicklung von Resonanzräumen zu nutzen, um beispielsweise auch Echokammern zu entzerren. Während weltweit zahlreiche Forscher und Unternehmen an KI- und AGI-Systemen arbeiten, fehlt es bisher an einem kohärenten Konzept und Design, das eine friedliche Koevolution von Mensch-Mensch und Mensch-Maschine ermöglicht. Basierend auf dem Konzept der World Models (LeCun, 2022) wird in diesem Beitrag ein Ansatz für ein umfassendes resonantes KI-Design diskutiert, das auf die Erreichung der Sustainable Development Goals (SDGs) der Vereinten Nationen ausgerichtet ist, mögliche Bedrohungen berücksichtigt und das Prinzip der sozialen Entropie nutzt, um prosperierende und friedliche Emergenzphänomene zu fördern.

Eine hohe soziale Entropie (Fragmentierung einer Gesellschaft) und die damit verbundene Radikalisierung einzelner Gruppen kann aus der Perspektive dieses Modells als Bedürfnis nach neuen emergenten Lösungen interpretiert werden. Wird die soziale Entropie jedoch nicht von den Betroffenen und Beteiligten selbst koordiniert und kontrolliert, ist mit totalitären Mechanismen zu rechnen, die eine uneingeschränkte Verfügung der Betroffenen und Beteiligten beanspruchen und damit die politische und gesellschaftliche Selbstorganisation außer Kraft setzen.

Weiterentwicklung demokratischer Prozesse

Das Resonanz-AI-Design erfordert als übergeordnetes Konzept innovative Lösungen zur Weiterentwicklung und Stärkung demokratischer Prozesse im 21. Jahrhundert. Der UN-Bericht Governing AI for Humanity: Final Report (2024) unterstreicht die Notwendigkeit einer globalen, inklusiven Herangehensweise an KI-Entwicklung und -Governance. Um die Integration von KI-Systemen in politische Entscheidungsfindungsprozesse zu gewährleisten und komplexe gesellschaftliche Herausforderungen übersichtlicher zu adressieren, müssen – wie im UN-Bericht gefordert – standardisierte, transparente und ethische KI-Lösungen entwickelt werden. Diese müssen durch entsprechende Governance-Strukturen und Capacity-Building-Maßnahmen unterstützt werden, um die Partizipation und Repräsentation der Bürger verbessern zu können (Helbing et al., 2017).

Dafür benötigt es Entwürfe für KI-gestützte Plattformen, die nachvollziehbar und unverzerrt große Mengen an Bürgerfeedback analysieren und synthetisieren, um ein nuancierteres Bild der öffentlichen Meinung zu erhalten (Landemore, 2020). Damit können Simulationsmodelle die langfristigen Auswirkungen politischer Entscheidungen ausarbeiten, was informiertere Debatten ermöglicht (Celi et al., 2021). Blockchain-basierte Abstimmungssysteme könnten die Transparenz und Sicherheit von Wahlen erhöhen (Pawlak et al., 2018), während KI-Assistenten Bürger bei der Navigation durch komplexe politische Themen unterstützen (Savaget et al., 2019). Entscheidend ist dabei, dass diese Technologien als Ergänzung und nicht als Ersatz für menschliche Deliberation und Entscheidungsfindung konzipiert werden (Danaher, 2016). Ein wohlgestaltetes Human-AI-Design für demokratische Prozesse zielt darauf ab, die kollektive Intelligenz der Gesellschaft zu stärken und eine inklusivere, responsivere und zukunftsfähigere Demokratie zu schaffen (Mulgan, 2018).

Der Status quo der AGI-Forschung

Die AGI-Forschung hat in den letzten Jahren enorme Fortschritte gemacht, insbesondere durch Durchbrüche im Bereich des maschinellen Lernens und neuronaler Netze (Goertzel & Pennachin, 2007). Dennoch ist die Entwicklung einer menschenähnlichen allgemeinen Intelligenz nach wie vor eine große Herausforderung. Ein zentrales Problem ist dabei die Integration verschiedener kognitiver Fähigkeiten zu einem kohärenten System (Lake et al., 2017).

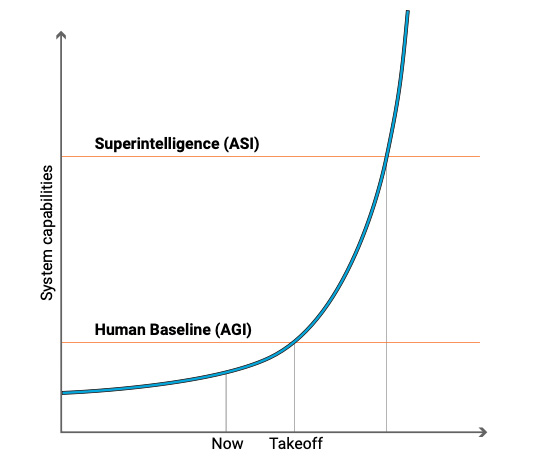

Ray Kurzweil prognostizierte in seinem Buch The Singularity Is Near (2005), dass die technologische Singularität um das Jahr 2045 eintreten würde, wenn künstliche Intelligenz die menschliche Intelligenz übertrifft und eine Superintelligenz (ASI) entsteht. Ben Goertzel nimmt in seinem aktuellen Buch The Consciousness Explosion (2024) eine deutlich kurzfristigere Perspektive ein. Er geht davon aus, dass nach Erreichen einer menschenähnlichen KI (HLAGI) die Entwicklung zu einer künstlichen Superintelligenz (ASI) sehr schnell folgen wird, da diese KI sich selbst studieren, verbessern und skalieren kann. Goertzel sieht diese Entwicklung nicht erst in Jahrzehnten, sondern deutet an, dass wir uns bereits in der finalen Phase vor dem Durchbruch zu einer HLAGI befinden (vgl. Fig. 1).

Der wirtschaftliche Wettbewerb um Marktanteile und Ressourcen erschwert eine koordinierte und ethisch fundierte Entwicklung von AGI-Systemen (Baum, 2017). Es besteht die Gefahr, dass der Wettkampf zwischen Unternehmen und Nationen auf die KI-Systeme selbst übertragen wird, mit potenziell destabilisierenden Folgen für die globale Ordnung.

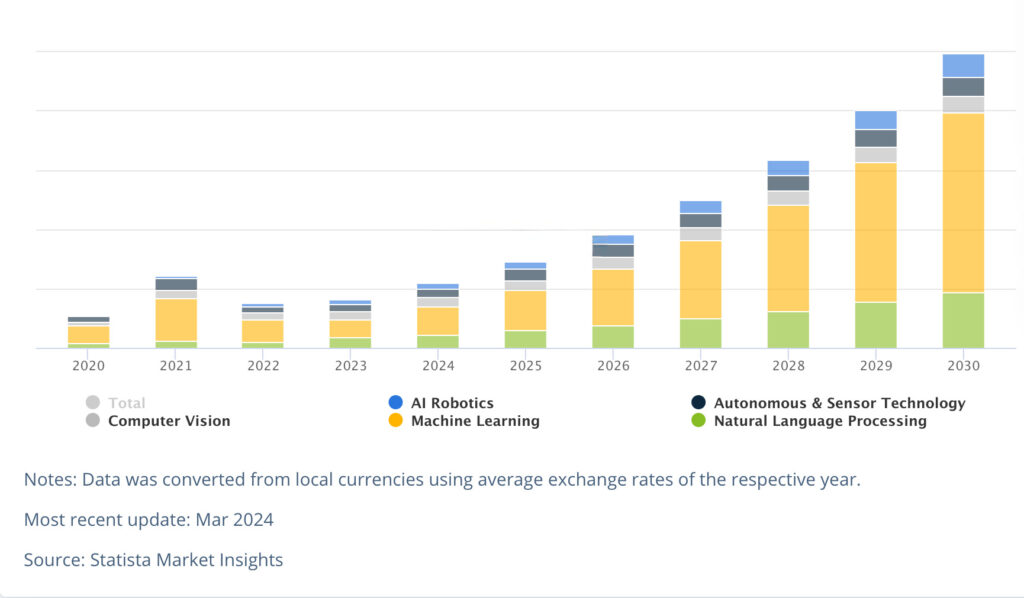

Der globale KI-Markt zeigt ein bemerkenswertes Wachstum mit einer prognostizierten Entwicklung von 184 Milliarden US-Dollar in 2024 auf 826,7 Milliarden US-Dollar bis 2030, was einer jährlichen Wachstumsrate (CAGR) von 28,46% entspricht (Statista 2024). Besonders interessant ist dabei die Entwicklung im Bereich Computer Vision, die es Computern ermöglicht, digitale Bild- und Videodaten zu interpretieren und zu verstehen. Dieser Teilmarkt wird laut aktuellen Prognosen bis 2028 ein Volumen von 41,3 Milliarden US-Dollar erreichen (Markets and Markets, 2023). Im Vergleich dazu wird für den Machine Learning-Markt, der sich mit der Entwicklung von selbstlernenden Algorithmen beschäftigt, ein noch stärkeres Wachstum auf 209,91 Milliarden US-Dollar bis 2029 vorhergesagt (Fortune Business Insights, 2024). Diese unterschiedlichen Wachstumsraten spiegeln die zentrale Bedeutung von Machine Learning als Grundlagentechnologie wider, während Computer Vision als Anwendungsfeld spezifischere, aber nicht weniger wichtige Einsatzbereiche abdeckt.

World Models als Ausgangspunkt

Ein vielversprechender Ansatz für die Entwicklung von AGI sind die von Yann LeCun (2022) vorgeschlagenen World Models. Diese zielen darauf ab, KI-Systeme mit einem umfassenden Verständnis der physikalischen und sozialen Welt auszustatten. World Models könnten als Grundlage für ein globales Human-AI-Design dienen, indem beispielsweise ein eigenes SDG-Modul in ein World Model integriert wird.

Mit großer Wahrscheinlichkeit wird sich die Vision künstlicher Superintelligenz nicht als ein einziges System in der Zukunft heraus kristallisieren, sondern als eine Vielzahl an künstlich intelligenten Systemen im Alltag, die als eine Einheit verstanden werden kann, ähnlich wie die Vielfalt der Menschen als Menschheit verstanden wird. Daher wird es auch verschiedene World Models geben. Diese können aber bereits jetzt als eine gemeinsame Basis für die Interaktion zwischen verschiedenen KI-Systemen und Menschen betrachtet werden.

Von World Models zu smarten Haushaltsgeräten

Ein globales Resonanz-AI-Design wird viele Ebenen der Mensch-Maschine-Interaktion umfassen, von hochkomplexen World Models bis hin zu alltäglichen smarten Haushaltsgeräten. Smarte Haushaltsgeräte könnten beispielsweise lokale Versionen von World Models implementieren, die mit den globalen Modellen interagieren. So könnte ein intelligenter Kühlschrank nicht nur den Lebensmittelverbrauch optimieren, sondern auch globale Nachhaltigkeitsziele in den Alltag der Menschen integrieren, indem er etwa Empfehlungen für klimafreundliche Ernährung gibt.

Quellen

Bailey, K. D. (1990). Social entropy theory. State University of New York Press.

Baum, S. D. (2017). On the promotion of safe and socially beneficial artificial intelligence. AI & Society, 32(4), 543-551.

Bostrom, N. (2014). Superintelligence: Paths, dangers, strategies. Oxford University Press.

Celi, L. A., Cellini, J., Charpignon, M. L., Dee, E. C., Dernoncourt, F., Eber, R., … & Wornow, M. (2021). Sources of bias in artificial intelligence that perpetuate healthcare disparities—A global review. PLOS Digital Health, 1(3), e0000022.

Danaher, J. (2016). The threat of algocracy: Reality, resistance and accommodation. Philosophy & Technology, 29(3), 245-268.

Fortune Business Insights. (2024). Machine Learning Market Size & Share Analysis. https://www.fortunebusinessinsights.com/machine-learning-market-102226

Goertzel, B., & Pennachin, C. (Eds.). (2007). Artificial general intelligence. Springer.

Goertzel, B. (2024). The Consciousness Explosion: A Mindful Human’s Guide to the Coming Technological and Experiential Singularity. With Gabriel Axel Montes. Humanity+ Press

Goldstein, J. (1999). Emergence as a construct: History and issues. Emergence, 1(1), 49-72.

Helbing, D., Frey, B. S., Gigerenzer, G., Hafen, E., Hagner, M., Hofstetter, Y., … & Zwitter, A. (2017). Will democracy survive big data and artificial intelligence? Scientific American, 25.

Kurzweil, R. (2005). The Singularity is Near: When Humans Transcend Biology. Viking Press.

Lake, B. M., Ullman, T. D., Tenenbaum, J. B., & Gershman, S. J. (2017). Building machines that learn and think like people. Behavioral and Brain Sciences, 40, e253.

Landemore, H. (2020). Open democracy: Reinventing popular rule for the twenty-first century. Princeton University Press.

LeCun, Y. (2022). A path towards autonomous machine intelligence. OpenReview.

Markets and Markets. (2023). Computer Vision Market by Component. https://www.marketsandmarkets.com/Market-Reports/computer-vision-market-186494767.html

Mulgan, G. (2018). Big mind: How collective intelligence can change our world. Princeton University Press.

Pawlak, M., Poniszewska-Marańda, A., & Kryvinska, N. (2018). Towards the intelligent agents for blockchain e-voting system. Procedia Computer Science, 141, 239-246.

Rosa, H. (2016). Resonanz: Eine Soziologie der Weltbeziehung. Suhrkamp Verlag.

Savaget, P., Chiarini, T., & Evans, S. (2019). Empowering political participation through artificial intelligence. Science and Public Policy, 46(3), 369-380.

Shneiderman, B. (2029). Human-AI design: Bridging the gap between artificial intelligence and human creativity. MIT Press.

Statista Market Insights. (2024). The market size in the Artificial Intelligence market worldwide. https://www.statista.com/outlook/tmo/artificial-intelligence/worldwide

United Nations, (2024). Governing AI for Humanity. Final Report. United Nations, AI Advisory Body. https://www.un.org/en/ai-advisory-body